The Corporate Governance Failure at the Heart of Sam Altman’s Ouster from OpenAI

サム・アルトマン退任の核心にあるコーポレート・ガバナンスの失敗 from OpenAI

Bing Image Creatorからレンダリング

In this piece I examine both the flawed corporate structure of OpenAI, and the neglect of governance evolution during a year of immense change. Those things led to the chaos that is still unfolding around the firing of Sam Altman. I conclude that alternative governance structures aren’t the issue, as some may readily surmise. Nonetheless, how OpenAI’s particular structure was set up and managed left it vulnerable to calamity. Other alternative structures, such as those instituted by Anthropic, were more thoughtfully put together, better harmonize the interests of multiple stakeholders, and should be more resilient to slow divergences of goals or sudden organizational shocks.

この記事では、OpenAIの欠陥だらけの企業構造と、大きな変化の年にガバナンスの進化を怠ったことの両方を検証する。これらのことが、サム・アルトマンの解雇を巡って今なお繰り広げられている混乱を招いた。私は、一部の人が容易に推測するように、代替的なガバナンス構造は問題ではないと結論づける。とはいえ、OpenAIの特殊な構造がどのように設定され、管理されていたかは、災難に対して脆弱なままだった。Anthropicが制定したような他の代替構造は、より思慮深くまとめられ、複数の利害関係者の利害をよりうまく調和させ、目標の緩やかな乖離や突然の組織的衝撃に対してより強いはずである。

On Friday, November 17, 2023, CEO and co-founder Sam Altman was unceremoniously fired from OpenAI by four members of the company’s non-profit board. As of Monday, November 20, 2023, three days after he was fired, it seems Sam Altman will be joining Microsoft as CEO of a new AI division that he will help create. Mr. Altman will be joined at Microsoft by former OpenAI board chair and COO Greg Brockman, who quit last Friday within hours of Mr. Altman’s ouster and his own demotion from the board. Other senior employees have since resigned, are intent on joining the new Microsoft division, and many more likely will do so. Reportedly, at least 650 of OpenAI’s 770 employees had signed a petition demanding that the company take Mr. Altman back and get rid of its Board. In addition to employee shock and outrage, OpenAI’s investors were very upset about Mr. Altman’s sudden firing, without advance notice to any of them and seemingly without substantive provocation. The company was on the verge of another financing round that would have entailed a secondary sale of employee shares, valuing OpenAI at $87 Billion dollars, triple its current valuation. That financing appears in jeopardy (certainly the valuation can’t stand with the amount of destabilization introduced to the company), which harms the interests of both employees and previous investors.

2023年11月17日(金)、CEO兼共同設立者のサム・アルトマンは、同社の非営利委員会の4人のメンバーによって、OpenAIから不本意ながら解雇された。解雇から3日後の2023年11月20日(月)現在、サム・アルトマン氏はマイクロソフトに入社し、AI部門の新設に携わることになるようだ。アルトマン氏は、OpenAIの前理事長兼COOであるグレッグ・ブロックマン氏と共にマイクロソフトに入社する。その後、他の幹部社員も辞職し、マイクロソフトの新部門に参加する意向であり、さらに多くの社員が参加する可能性がある。報道によると、OpenAIの従業員770人のうち少なくとも650人が、アルトマン氏の復帰と取締役会の解任を求める嘆願書に署名したという。従業員のショックと怒りに加え、OpenAIの投資家たちは、誰一人への事前通告もなく、実質的な挑発もないように見えるAltman氏の突然の解雇に非常に動揺していた。同社は、従業員株式の二次売却を伴う別の資金調達ラウンドを目前にしており、OpenAIの評価額は現在の3倍の870億ドルに達していた。この資金調達は危機に瀕しているようで、(確かに、会社に導入された不安定化の量では、評価は耐えられない)従業員と以前の投資家の両方の利益を損なっている。

Despite scrambling over the weekend to repair the damage done by his firing and bring Mr. Altman back, the board instead preserved their own roles (for the time being) and quickly demoted interim CEO Mira Murati (OpenAI’s CTO) — designated as interim just Friday — in favor of Emmett Shear, former CEO of Twitch. In the wee hours of Monday morning, Ilya Sutskever, co-founder and Chief Scientist of OpenAI and one of the board members who orchestrated Mr. Altman’s ouster, expressed remorse over what has transpired: “I deeply regret my participation in the board’s actions. I never intended to harm OpenAI.” The fate of OpenAI hangs in the balance. The company has been harmed, deeply, and it remains to be seen how it will recover. Regardless of what prompted the board to see fit to remove Mr. Altman in the first instance, certainly in no one’s perfect world would the chaos and uncertainty brought about by both the ouster and the manner in which it was undertaken have been a goal. This is all a grand fiasco. Of the many things to be said (and still to be discovered) about the Shakesperian drama unfolding before our eyes, it is safe to say now that it is an unmitigated failure of corporate stewardship.

アルトマン氏の解雇によるダメージを修復し、アルトマン氏を復帰させようと週末に奔走したにもかかわらず、取締役会はその代わりに(当面の間)自分たちの役割を温存し、金曜日に暫定CEOに指名されたばかりのミラ・ムラーティ(OpenAIのCTO)をすぐに降格させ、Twitchの元CEOであるエメット・シアーを起用した。月曜日の早朝、OpenAIの共同設立者兼チーフ・サイエンティストであり、アルトマン氏の更迭を画策した取締役の一人であるイリヤ・スーツケバー氏は、今回の事態について反省の意を表明した:「理事会の行為に加担したことを深く反省しています。私はOpenAIを傷つけるつもりはありませんでした」。OpenAIの運命は天秤にかかっている。同社は深く傷つけられ、どのように回復するかは未知数だ。取締役会がアルトマン氏の解任に踏み切ったきっかけが何であったかはさておき、解任とそのやり方によってもたらされた混乱と不確実性は、誰の完全な世界においても目標とされるものではなかっただろう。これはすべて大失敗である。目の前で繰り広げられるシェイクスピア劇について語られるべき(そしてまだ発見されていない)多くの事柄の中で、今言えることは、これは企業の管理責任における大失敗であるということだ。

What transpired with OpenAI represents a huge and unmistakable failure of corporate governance. This is the case whether Altman returned after his firing or not (who knows, he still might). How he was terminated in the first instance, and the chaos that followed, provide all the evidence of failure that we need. Through the lens of governance, we can get an interesting and perhaps the most probative view on what went wrong at OpenAI. The data points from the last few days are susceptible to multiple readings. Even those who agree there was a failure of governance may ascribe different reasons for it. Some commentators will be happy that the will of the board prevailed; they will see that as a win for board governance (see, e.g., here, arguing that Altman’s quick return to OpenAI based on employee and investor pressure after his firing would have been a failure). Others may blame the alternative governance structure of the company and contend that anything too creative or exotic that leaves key shareholders out of oversight and decision making is flawed.

オープンAIで起きたことは、コーポレート・ガバナンスの紛れもない大失敗である。これは、アルトマンが解雇後に復帰したかどうかにかかわらず(誰にもわからないが、彼はまだ復帰するかもしれない)。アルトマンが最初に解雇された経緯とその後の混乱は、私たちが必要とする失敗の証拠をすべて提供してくれる。ガバナンスというレンズを通して、OpenAIで何がうまくいかなかったのかについて、興味深い、そしておそらく最も有力な見解を得ることができる。ここ数日のデータは、複数の読み方ができる。ガバナンスに失敗があったことに同意する人たちでさえ、その理由は異なるかもしれない。取締役会の意志が勝ったことを喜ぶコメンテーターもいるだろう。彼らはそれを取締役会のガバナンスの勝利とみなすだろう(例えば、アルトマンが解雇された後、従業員と投資家の圧力に基づいてOpenAIにすぐに復帰したことは失敗だったと主張するこちらを参照)。また、会社の代替ガバナンス構造を非難し、主要株主を監督や意思決定から外すような独創的すぎるものや異国的なものは欠陥があると主張する人もいるかもしれない。

Basic Corporate Governance

コーポレート・ガバナンスの基本

For profit companies typically have boards of directors. Venture-backed start-up boards typically include one or two company executives, as well as representatives from the VC firms who contributed the most capital. It is healthy to have other outside, or independent, directors, who can bring fresh perspectives on governance and management matters without being overly swayed by self-interest. Corporate board members have fiduciary obligations to the company, typically to promote positive business performance, ensure legal and regulatory compliance and maximize shareholder returns.

営利企業は通常、取締役会を持っている。ベンチャー企業による新興企業の取締役会には、通常、1人か2人の会社幹部と、最も多くの資本を提供したベンチャーキャピタル会社の代表者が含まれる。私利私欲に過度に左右されることなく、ガバナンスや経営事項に関して新鮮な視点をもたらすことができる社外取締役(独立取締役)がいることは健全なことである。会社の取締役は、会社に対して受託者責任を負っており、通常、積極的な業績を促進し、法律や規制の遵守を確保し、株主利益を最大化する義務がある。

Nonprofit company boards operate in much the same way. There are independent board directors, perhaps a representative from one or more of the biggest philanthropic backers of the organization and some executive staff. The big difference is that nonprofits don’t exist to maximize shareholder value or profit. They typically are formed with a charitable or social benefit goal as their primary mission.

非営利企業の理事会もほぼ同じように運営されている。独立した理事がおり、おそらくその組織の最大の支援者である慈善団体の代表が1人以上、そして数人の幹部スタッフがいる。大きな違いは、非営利組織は株主価値や利益を最大化するために存在するのではないということだ。非営利団体は通常、慈善活動や社会的利益を第一の使命として設立される。

Neither for profit or nonprofit boards have specific fiduciary obligations to their organization’s employees or outside stakeholders (such as customers or business partners) other than generally maximizing business performance. Most healthy organizations take care to attend to diverse stakeholder interests, with the knowledge that doing so and acting beyond what fiduciary duties or legal requirements may require tends to support achievement of business performance, whether in maximizing shareholder value or fulfilling a charitable or social benefit goal.

営利・非営利を問わず、取締役会は、組織の従業員や社外のステークホルダー(顧客やビジネス・パートナーなど)に対して、一般的に業績を最大化すること以外に、特定の受託者責任を負うことはない。ほとんどの健全な組織は、多様なステークホルダーの関心に注意を払い、そうすることで、受託者義務や法的要件が要求する以上の行動をとることが、株主価値の最大化であれ、慈善活動や社会的利益の目標の達成であれ、業績の達成を支援する傾向にあることを認識している。

Corporate Governance at OpenAI

OpenAIのコーポレート・ガバナンス

OpenAI was founded as a nonprofit in late 2015. The non-profit form was chosen “with the goal of building safe and beneficial artificial general intelligence for the benefit of humanity.” As framed by the company, OpenAI “believed a 501(c)(3) would be the most effective vehicle to direct the development of safe and broadly beneficial AGI while remaining unencumbered by profit incentives.” However, after a few years in operation, the company realized that the capital needed to fuel its ambitions would not be obtainable via a nonprofit entity only. As OpenAI explains,

OpenAIは2015年末に非営利団体として設立された。非営利の形態は、"人類の利益のために安全で有益な人工知能を構築することを目的として "選ばれた。同社の説明によれば、OpenAIは "501(c)(3)が、利益インセンティブに邪魔されることなく、安全で広く有益なAGIの開発を指示する最も効果的な手段であると考えた"。しかし、設立から数年後、同社はその野望を実現するために必要な資本が非営利団体だけでは得られないことに気づいた。オープンAIの説明によれば

“It became increasingly clear that donations alone would not scale with the cost of computational power and talent required to push core research forward, jeopardizing our mission. So we devised a structure to preserve our Nonprofit’s core mission, governance, and oversight while enabling us to raise the capital for our mission”

「寄付だけでは、中核となる研究を推し進めるために必要な計算能力や人材にかかるコストに対応できず、私たちの使命を危うくすることが次第に明らかになってきました。そこで私たちは、非営利団体の中核となる使命、ガバナンス、監視を維持しながら、使命のための資金を調達できる仕組みを考案したのです

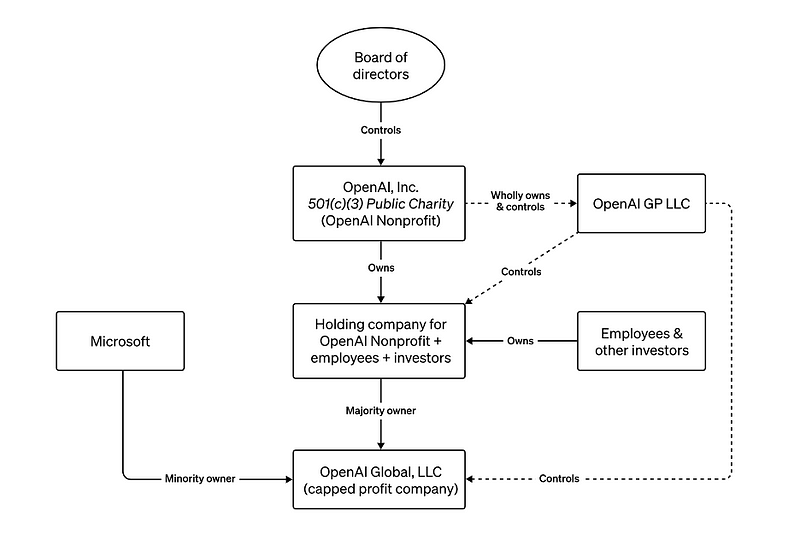

In anticipation of receiving a $1 Billion initial investment from Microsoft in 2019, OpenAI under Mr. Altman’s stewardship created for-profit subsidiaries under the original nonprofit. These for-profit entities would legally be able to accept outside investment and provide equity interests to OpenAI employees. The key for-profit subsidiary included a “capped profit” mechanism, whereby investors could only hope to achieve up to a 100x return on their investments and all excess above that would be returned to the nonprofit for use towards its broader mission.

2019年にマイクロソフトから10億ドルの初期投資を受けることを見越して、アルトマン氏の管理下にあるOpenAIは、元の非営利組織の下に営利目的の子会社を設立した。これらの営利事業体は法的に外部からの投資を受け入れ、OpenAIの従業員に株式を提供することができる。主要な営利子会社には「上限利益」メカニズムが含まれており、投資家は投資に対して100倍までのリターンしか望めず、それ以上の超過分はすべて非営利団体に返還され、より広範なミッションのために使用される。

OpenAIの一般的な企業構造。唯一の取締役会が、他のすべての関連会社の上に位置し、コントロールする非営利団体をコントロールしている。サム・アルトマンが更迭される直前の理事会は、OpenAIの幹部3名(グレッグ・ブロックマン(議長)、サム・アルトマン、イリヤ・スッツケバー)に加え、独立理事3名(アダム・ダンジェロ(クオラCEO)、ターシャ・マコーリー(ジオシム・システムズCEO)、ヘレン・トナー(ジョージタウン大学安全保障・新興技術センター戦略・基礎研究助成ディレクター)で構成されていた。

This approach was not without its controversy. It prompted senior defections from the company, leading, for instance, to the founding of Anthropic in 2021 by Dario and Daniela Amodei. Apparently, some tensions remained from the decisions to accept outside funding, which intensified in 2023 once ChatGPT became a breakout success, with Microsoft and other investors pouring many Billions into the company. Worth noting is that Ilya Sutskever did acknowledge and seemed sanguine about the new structure in 2019 when it was created. He stated at that time “In order to build AGI you need to have billions of dollars of investment … We created this structure in order to raise this capital while staying aligned with our mission.”

このアプローチには賛否両論があった。例えば、ダリオとダニエラ・アモデイは2021年にAnthropicを設立した。どうやら、外部からの資金を受け入れるという決断には緊張が残っていたようで、2023年にChatGPTが大成功を収め、マイクロソフトや他の投資家が何十億ドルもの資金を同社に注ぎ込むと、その緊張はさらに高まった。注目すべきは、2019年に新体制が発足した際、イリヤ・スーツケバーが新体制を認め、悲観的に見えたことだ。彼はその時、「AGIを構築するためには、数十億ドルの投資が必要です......私たちは、私たちの使命に沿いながら、この資本を調達するためにこの構造を作りました」と述べた。

Governance & Judgment Failures

ガバナンスとジャッジメントの失敗

As outlined, OpenAI’s governance structure is a retrofit. The failure of governance that it experienced in the lead up to November 17 is in part due to that structure. But in larger part it is due to how the structure was neglected while the company quickly changed.

概説したように、OpenAIのガバナンス構造は後付けである。11月17日に至るまでに経験したガバナンスの失敗は、その構造によるところもある。しかし、より大きな部分は、会社が急速に変化する一方で、構造がどのように放置されたかによる。

→ Letting the nonprofit board membership languish following defections in early 2023. In addition to the six members that it had immediately before Mr. Altman’s firing and Mr. Brockman’s demotion on November 17, 2023, the OpenAI Board previously counted as members Reid Hoffman, an experienced Silicon Valley company operator and investor, Will Hurd, a former Texas Congressman, and Shivon Zilis, a director of Elon Musk’s Neuralink. These three stepped down as board members in the Spring of 2023 owing to various conflicts. Inadequate effort was made to replace them or to supplement the board with additional expertise and experience, as might befit a company suddenly worth tens of billions of dollars overnight. Mr. Altman may have had a lot of trust in the three outside directors, and certainly in Mr. Brockman. But trust is sometimes inadequate to preserve prudent, transparent decision making and good judgment, especially. It is entirely unclear whether Adam D’Angelo, Helen Toner, Tasha McCauley and Ilya Sutskever had the depth and breadth of experience to guide OpenAI against its nonprofit mission, muchless that balanced with a broader set of stakeholder interests in a multibillion dollar, globally prominent enterprise. It’s clear they exercised poor judgment in how they went about terminating Mr. Altman. Everyone would have been better served by a bigger board, with more maturity and diverse expertise on matters concerning AGI and its prospective social impact as well as harmonizing these interests with those of investors and other stakeholders.

→ 2023年初頭の脱退後、非営利団体の理事会メンバーを停滞させたこと。2023年11月17日にアルトマン氏が解雇され、ブロックマン氏が降格される直前の6人に加え、OpenAI理事会には、シリコンバレーの企業経営者であり投資家でもあるリード・ホフマン氏、元テキサス州下院議員のウィル・ハード氏、イーロン・マスク氏のNeuralinkの取締役であるシヴォン・ジリス氏が理事として名を連ねていた。この3人は2023年春、さまざまな利害の衝突により取締役を退任した。一夜にして数百億ドルの価値を持つ企業にふさわしく、彼らの後任を補充したり、さらなる専門知識や経験を取締役会に補充したりする努力は不十分だった。アルトマン氏は、3人の社外取締役、そしてブロックマン氏に対して大きな信頼を寄せていたかもしれない。しかし、特に慎重で透明性のある意思決定と的確な判断を維持するには、信頼が不十分な場合がある。アダム・ダンジェロ、ヘレン・トナー、ターシャ・マコーリー、イリヤ・スーツキーヴァーの4人が、非営利の使命に照らしてOpenAIを導くだけの深みと幅のある経験を持っていたかどうかはまったく不明であり、ましてや数十億ドル規模の世界的に著名な企業において、より広範な利害関係者の利益とバランスをとっていたかどうかはわからない。彼らがアルトマン氏の解雇に踏み切った判断が甘かったのは明らかです。AGIとその将来的な社会的影響に関する事項について、より成熟した多様な専門知識を持ち、投資家や他の利害関係者の利害と調和させる、より大きな取締役会を設置した方が、誰もがより良い結果を得られただろう。

→ Inadequate review processes for the CEO. As of this writing, I do not have access to OpenAI, Inc.’s bylaws or other governing documents. However, we know that the decision to fire Mr. Altman arose from a majority vote (four of the six directors). CEO’s serve at the pleasure of their boards and can be removed based on a majority decision. However, disagreements over strategic direction of a company typically should not involve termination of an otherwise high performing CEO without malfeasance or a persisting impasse deemed detrimental to the business. Prudent practice typically involves investigation, documentation and articulation of objective evidence of deficits or misdeeds. The OpenAI board’s stated reason for terminating Mr. Altman is the vague characterization that he was not “consistently candid” with the Board, “hindering its ability to exercise its responsibilities.” However, subsequent revelations make clear that he was not engaged in any malfeasance and there was “no specific disagreement about safety.” Without knowing more, the decision to oust Mr. Altman seems based on personality conflicts or personal disagreements that plausibly should or could have been subject to dispute resolution procedures or consultation with other interested stakeholders. Governing documents don’t always provide for such procedures, but good governance often involves following such procedures voluntarily where wrongdoing or underperformance is not otherwise presented by a CEO. The nonprofit board had no seats for investors or even an advisory committee of investors. On the one hand, this may have avoided any corrupting influences. On the other, it deprived the board of the wisdom that “smart money” can often bring to the table, particularly in situations involving difficult strategic decisions or disagreements having material impact on the company.

→ CEO のレビュープロセスが不十分。この原稿を書いている時点では、OpenAI, Inc.の細則やその他の統治文書にアクセスすることはできません。しかし、アルトマン氏を解雇するという決定が、多数決(6人の取締役のうち4人)によってなされたことは知っています。CEOは取締役会の意のままに職務を遂行し、過半数の決定に基づいて解任することができます。しかし、会社の戦略的方向性をめぐる意見の相違は、通常、不正行為や事業に有害とみなされる持続的な行き詰まりがなければ、高い業績を上げている最高経営責任者の解任につながるべきではありません。慎重な慣行には通常、調査、文書化、赤字や悪行の客観的証拠の明示が含まれます。オープンエイの取締役会は、アルトマン氏を解任した理由として、彼が取締役会に対して「一貫して率直」でなかったため、「取締役会の責任遂行に支障をきたした」という曖昧な説明を述べています。しかし、その後明らかになったことは、彼が悪事に手を染めていたわけではなく、"安全性についての具体的な意見の相違はなかった "ということである。もっと詳しいことがわからなければ、アルトマン氏を更迭するという決定は、人格的な対立や個人的な意見の相違に基づいているように思われ、紛争解決手続きや他の利害関係者との協議の対象となるべきであったか、あるいはなり得たはずである。統治文書が必ずしもそのような手続きを定めているとは限らないが、優れたガバナンスとは、不正行為や業績不振がCEOから提示されない場合、自発的にそのような手続きを踏むことを含むことが多い。非営利組織の理事会には、投資家のための席はなく、投資家からなる諮問委員会すらなかった。一方では、これは腐敗的な影響を避けるためかもしれない。他方では、特に会社に重大な影響を及ぼす困難な戦略的決定や意見の相違を伴う状況において、「賢明な資金」がしばしばテーブルにもたらすことができる知恵を取締役会から奪っていた。

→ The board overstepped an overly narrow mission focus. The mission of OpenAI is “to ensure that artificial general intelligence benefits all of humanity.” In that regard, safety for AGI is listed as a paramount objective. AGI, of course, remains an aspirational goal for OpenAI. Per Mr. Altman in early November, the company’s current LLM products are not the way to get to AGI or superintelligence. As such, the commercial success of products like ChatGPT and GPT-4 do not implicate AGI or AGI-related safety. There are plenty of immediate policy and user safety issues to be concerned about based on the AI products currently available to the public. But these are not of the existential risk or more severe public safety risk variety associated with AGI or Superintelligent AI. Nor was there a promise to permit Microsoft or others access to potentially dangerous technology. For instance, since at least June 2023, the company had made clear that:

→ 理事会はミッションの焦点を絞りすぎた。OpenAIの使命は、"人工知能が全人類に利益をもたらすようにすること "である。その点で、AGIの安全性は最重要目標として挙げられている。もちろん、AGIはOpenAIの熱望的な目標であることに変わりはない。11月初旬にアルトマン氏が語ったところによると、同社の現在のLLM製品は、AGIや超知能に到達するための手段ではないという。そのため、ChatGPTやGPT-4のような製品の商業的な成功は、AGIやAGI関連の安全性を意味するものではない。現在一般に入手可能なAI製品に基づく政策やユーザーの安全性には、懸念すべき問題が山積している。しかし、これらはAGIやスーパーインテリジェントAIに関連する存立危機リスクやより深刻な公共の安全リスクの類ではない。また、マイクロソフトや他の企業が潜在的に危険な技術にアクセスすることを許可するという約束もなかった。例えば、少なくとも2023年6月以降、同社は次のように明言していた:

“While our partnership with Microsoft includes a multibillion dollar investment, OpenAI remains an entirely independent company governed by the OpenAI Nonprofit. Microsoft has no board seat and no control. And … AGI is explicitly carved out of all commercial and IP licensing agreements.”

「マイクロソフトとのパートナーシップには数十億ドルの投資が含まれていますが、OpenAIはOpenAI Nonprofitによって管理される完全に独立した企業であることに変わりはありません。マイクロソフトは取締役会の席もなく、コントロールもできません。そして......AGIはすべての商業およびIPライセンス契約から明確に切り離されています。"

Whatever concerns the OpenAI board may have held about the commercial direction of the company under Mr. Altman’s leadership, these did not immediately implicate their mandate under the stated mission of the non-profit. Moreover, Mr. Sutskever himself had assumed control over AGI and Superintelligence research at OpenAI, particularly the goal of developing and managing those hoped-for achievements safely.

OpenAIの理事会が、アルトマン氏のリーダーシップの下での会社の商業的な方向性についてどのような懸念を抱いていたとしても、それが直ちに非営利団体の明示された使命に関わるものではなかった。さらに、サッツケバー氏自身は、オープンAIにおけるAGIと超知能の研究、特にこれらの期待される成果を安全に開発・管理することを目標として、その管理を引き受けていた。

The overall point here is that once OpenAI changed overnight and brought the world along with it, it should have been abundantly clear that more was needed to harmonize its various motives and interests. The business of the company was burgeoning around Generative AI, and that, in and of itself, was not the mission focus of the nonprofit running the company. Either the nonprofit’s mission needed to be expanded, or more decision making and leadership over its broader pursuits needed to be devolved to subsidiary entities operating its Generative AI business.

ここでの全体的なポイントは、OpenAIが一夜にして変化し、世界を巻き込んだ時点で、そのさまざまな動機と関心を調和させるためにもっと多くのことが必要であることは、十分に明らかだったはずだということだ。同社のビジネスはジェネレーティブAIを中心に急成長していたが、それ自体は同社を運営する非営利団体のミッションの焦点ではなかった。非営利団体の使命を拡大するか、より広範な追求に対する意思決定とリーダーシップを、ジェネレーティブAI事業を運営する子会社に委譲する必要があった。

→ Failing to Anticipate Obvious Ramifications. The ultimate governance failure was the failure by the Board to anticipate the extreme disruption to OpenAI that their actions would introduce. These may all be a function of a more basic lack of leadership savvy, experience and expertise. However, that there would be the kind of fallout that there has been since Friday should have been expected. Since the public launch of ChatGPT one year ago, Sam Altman has become a leading figure in the global AI movement. He has functioned as a credible, articulate ambassador for both the amazing potential of AI as well as its risks. Moreover, he has been a capable steward of financing and product development at the company, beloved by investors, employees and silicon valley leadership more broadly. For many, Sam Altman is not only the face and voice of OpenAI, but he IS the company. In such situations, it is incumbent on a board to lay sufficient groundwork for an ouster. Having a coherent succession plan, a sophisticated messaging plan and connecting confidentially with key stakeholders in advance would all be critical. None of these measures appeared to have been undertaken at all, or else with sufficient forethought and planning. It is as yet unclear whether the board had sound counsel, not only about the technical viability of terminating Mr. Altman, but about the propriety of doing so under the circumstances in which the termination unfolded.

→ 明白な影響を予測しなかったこと。究極のガバナンスの失敗は、取締役会が、自分たちの行動がOpenAIにもたらす極度の混乱を予測しなかったことだ。これらはすべて、より基本的なリーダーシップの経験不足、経験不足、専門知識不足によるものかもしれない。しかし、金曜日以降、このような影響が出ることは予想されていたはずです。1年前にChatGPTを立ち上げて以来、サム・アルトマンは世界のAIムーブメントをリードする人物となった。彼は、AIの驚くべき可能性とそのリスクの両方について、信頼できる明確な大使として機能してきた。さらに、投資家、従業員、シリコンバレーの指導者たちから広く愛され、会社の資金調達と製品開発の有能な管理者でもある。多くの人にとって、サム・アルトマンはOpenAIの顔であり声であるだけでなく、会社そのものなのだ。このような状況では、取締役会は更迭のための十分な下準備をする義務がある。首尾一貫した後継者計画、洗練されたメッセージング計画、主要な利害関係者と事前に内密に連絡を取り合うこと、すべてが重要だろう。これらの対策はまったく講じられていないか、さもなければ十分な思慮と計画性がなかったように見える。取締役会が、アルトマン氏の解任が技術的に可能かどうかだけでなく、解任が展開された状況下での解任の妥当性についても、適切な助言を受けていたかどうかはまだ不明である。

Alternative Structures with Aligned Incentives

インセンティブを揃えた代替構造

The commercial success of ChatGPT, a public beta research project, took everyone off guard. It created a commercial opportunity zone no one expected and no one had planned for. No one could have, because the runaway success of ChatGPT and its industry transforming impact had no precedent in technology history. The nonprofit needed to evolve, but, instead, lost Board members to conflicts and failed to replace or supplement them with additional experience or skill sets appropriate to what OpenAI was becoming in 2023. Because it did not, trust broke down, unsound judgment was exercised by the remaining board majority and chaos ensued. Mr. Altman does share in the responsibility for not attending to the very governance deficiencies that arose to undermine him, though, perhaps, his trusting nature is generally a virtue. Even the well-intended can be overcome by structures that don’t adequately align incentives, contain proper safeguards or sufficiently define decision making procedures. Many may be tempted to impugn all alternative structures as a result. I do not believe this is warranted.

公開ベータ・リサーチ・プロジェクトであるChatGPTの商業的成功は、皆を油断させた。誰も予想せず、誰も計画しなかった商機が生まれたのです。ChatGPTの大成功と業界を変革するインパクトは、テクノロジーの歴史において前例がなかったからだ。非営利団体は進化する必要がありましたが、その代わりに理事会のメンバーを対立で失い、2023年にOpenAIが目指す姿にふさわしい経験やスキルを持つメンバーを補充することができませんでした。そうしなかったため、信頼は崩れ、残った理事会の大多数によって不健全な判断が下され、混乱が生じたのです。アルトマン氏は、自分を貶めるために生じたガバナンスの欠陥に目を向けなかった責任を負っているが、おそらく彼の信頼できる性格は一般的には美徳なのだろう。たとえ善意者であっても、インセンティブを適切に調整せず、適切なセーフガードを含まず、意思決定手順を十分に定義していない構造によって克服されることがある。その結果、すべての代替構造を非難したくなる人も多いだろう。しかし、私はそれが正当化されるとは思わない。

A non-profit was not the best vehicle for OpenAI’s ambitions in 2015, and certainly not in 2019, when it first revisited its corporate structure. Since 2013, the state of Delaware created public benefit corporations (PBCs). This corporate form embraces that a company may have goals beyond profit maximization and have stakeholders it wishes to be accountable to beyond its shareholders. Importantly PBCs can embrace both the pursuit of profit and social benefit goals in a cohesive corporate structure. Its board can include investors, and decision making at the board level must take into account the interests of all identified stakeholders at all times.

非営利法人は、2015年、そして2019年に初めて法人形態を見直したオープンエイの野心に最適な手段ではなかった。2013年以降、デラウェア州は公益法人(PBC)を設立した。この企業形態は、企業が利益最大化を超えた目標を持ち、株主以外にも説明責任を果たしたいステークホルダーがいることを受け入れるものである。重要なことは、PBCは、利益追求と社会的利益追求の双方を、一体化した企業構造の中に取り込むことができるということである。その取締役会には投資家を含めることができ、取締役会レベルでの意思決定は、特定されたすべてのステークホルダーの利益を常に考慮しなければならない。

This is the form of corporation that Anthropic elected to create, following their founders’ disillusionment with OpenAI’s approach. In addition to a PBC, Anthropic also formed a long term benefit trust (LTBT). By design, the LTBT is a rotating body whose members serve year-long terms. The LTBT is “purpose” driven, and meant to hold the broader mission for socially beneficial uses of AI in mind within the scope of their authority and decision making. They can select the vast majority of the PBC’s board members, but do not themselves sit on the Anthropic board. As a novel corporate structure, the Anthropic LTBT + PBC builds in some design flexibility, acknowledging that some fine tuning may be desirable along the way. This kind of structure has yet to be tested, either with a crisis or litigation. However, based on its contours we can readily see how it would be more resilient to the kind of crisis faced by OpenAI. Not only might a termination event not been reached were OpenAI to have a structure more along these lines, but how that event was handled would likely have been done much more responsibly than what we have seen over the past several days.

これは、創業者がOpenAIのアプローチに幻滅したことを受け、Anthropicが選択した法人形態である。PBCに加えて、Anthropicは長期給付信託(LTBT)も設立した。LTBTは持ち回り制で、メンバーは1年間の任期を務める。LTBTは「目的」主導であり、権限と意思決定の範囲内で、AIの社会的に有益な利用という広範な使命を念頭に置くことを意図している。LTBTは、PBCの理事会メンバーの大半を選出することができるが、LTBT自身がAnthropicの理事会に出席することはない。斬新な企業構造として、人間工学LTBT+PBCは、設計に柔軟性を持たせており、途中で微調整が望ましい場合もあることを認めている。このような構造は、危機や訴訟でまだテストされていない。しかし、その輪郭に基づけば、OpenAIが直面するような危機に対して、どのような耐性を持つかはすぐにわかる。OpenAIがこのような体制をとっていれば、契約解除に至らなかったかもしれないだけでなく、そのような事態にどのように対処したかは、ここ数日見てきたものよりもずっと責任あるものであっただろう。

Copyright © 2023 Duane R. Valz. Published here under a Creative Commons Attribution-NonCommercial 4.0 International License

著作権 © 2023 ドゥエイン・R・バルツ。クリエイティブ・コモンズ 表示 - 非営利 4.0国際 ライセンスの下にここに掲載

The author works in the field of machine learning/artificial intelligence. The views expressed herein are his own and do not reflect any positions or perspectives of current or former employers.

著者は機械学習/人工知能の分野で働いている。ここで述べられている見解は彼自身のものであり、現在または以前の雇用主の立場や見解を反映するものではない。

If you enjoyed this article, consider trying out the AI service I recommend. It provides the same performance and functions to ChatGPT Plus(GPT-4) but more cost-effective, at just $6/month (Special offer for $1/month). Click here to try ZAI.chat.

この記事を楽しんでいただけたなら、私がお勧めするAIサービスを試してみることを検討してください。ChatGPTプラス(GPT-4)と同じ性能・機能で、月額$6(特別価格$1/月)とコストパフォーマンスに優れています。 ZAI.chat.を試すにはここをクリック.